single

Gradiententape

Veeg om het menu te tonen

Gradient Tape

Inzicht in fundamentele tensorbewerkingen maakt het mogelijk deze processen te stroomlijnen en te versnellen met behulp van ingebouwde TensorFlow-functionaliteiten. Het eerste van deze geavanceerde hulpmiddelen dat wordt behandeld, is Gradient Tape.

Wat is Gradient Tape?

Dit hoofdstuk behandelt een van de fundamentele concepten in TensorFlow, de Gradient Tape. Deze functionaliteit is essentieel voor het begrijpen en toepassen van gradient-gebaseerde optimalisatietechnieken, met name in deep learning.

Gradient Tape in TensorFlow is een hulpmiddel dat bewerkingen registreert voor automatische differentiatie. Wanneer bewerkingen binnen een Gradient Tape-blok worden uitgevoerd, houdt TensorFlow alle uitgevoerde berekeningen bij. Dit is vooral nuttig bij het trainen van machine learning-modellen, waarbij gradiënten nodig zijn om modelparameters te optimaliseren.

In essentie is een gradiënt een verzameling partiële afgeleiden.

Gebruik van Gradient Tape

Voor het gebruik van Gradient Tape, volg deze stappen:

- Maak een Gradient Tape-blok aan: gebruik

with tf.GradientTape() as tape:. Binnen dit blok worden alle berekeningen gevolgd; - Definieer de berekeningen: voer operaties uit met tensors binnen het blok (bijvoorbeeld het definiëren van een forward pass van een neuraal netwerk);

- Bereken de gradiënten: gebruik

tape.gradient(target, sources)om de gradiënten van het doelwit ten opzichte van de bronnen te berekenen.

Eenvoudige gradiëntberekening

Een eenvoudig voorbeeld om dit beter te begrijpen.

123456789101112131415import tensorflow as tf # Define input variables x = tf.Variable(3.0) # Start recording the operations with tf.GradientTape() as tape: # Define the calculations y = x * x # Extract the gradient for the specific input (`x`) grad = tape.gradient(y, x) print(f'Result of y: {y}') print(f'The gradient of y with respect to x is: {grad.numpy()}')

Deze code berekent de gradiënt van y = x^2 bij x = 3. Dit is gelijk aan de partiële afgeleide van y ten opzichte van x.

Meerdere Partiële Afgeleiden

Wanneer de output wordt beïnvloed door meerdere inputs, kan een partiële afgeleide worden berekend ten opzichte van elk van deze inputs (of slechts een geselecteerde subset). Dit wordt bereikt door een lijst van variabelen op te geven als de parameter sources.

De output van deze operatie zal een overeenkomstige lijst van tensors zijn, waarbij elke tensor de partiële afgeleide voorstelt ten opzichte van elk van de in sources opgegeven variabelen.

1234567891011121314151617import tensorflow as tf # Define input variables x = tf.Variable(tf.fill((2, 3), 3.0)) z = tf.Variable(5.0) # Start recording the operations with tf.GradientTape() as tape: # Define the calculations y = tf.reduce_sum(x * x + 2 * z) # Extract the gradient for the specific inputs (`x` and `z`) grad = tape.gradient(y, [x, z]) print(f'Result of y: {y}') print(f"The gradient of y with respect to x is:\n{grad[0].numpy()}") print(f"The gradient of y with respect to z is: {grad[1].numpy()}")

Deze code berekent het gradiënt van de functie y = sum(x^2 + 2*z) voor gegeven waarden van x en z. In dit voorbeeld wordt het gradiënt van x weergegeven als een 2D-tensor, waarbij elk element overeenkomt met de partiële afgeleide van de betreffende waarde in de oorspronkelijke x-matrix.

Voor aanvullende inzichten in de mogelijkheden van Gradient Tape, waaronder hogere-orde afgeleiden en het extraheren van de Jacobiaanmatrix, raadpleeg de officiële TensorFlow documentatie.

Veeg om te beginnen met coderen

Het doel is om de gradiënt (afgeleide) van een gegeven wiskundige functie op een specifiek punt te berekenen met behulp van TensorFlow's Gradient Tape. De functie en het punt worden gegeven, en je ziet hoe je TensorFlow gebruikt om de gradiënt op dat punt te bepalen.

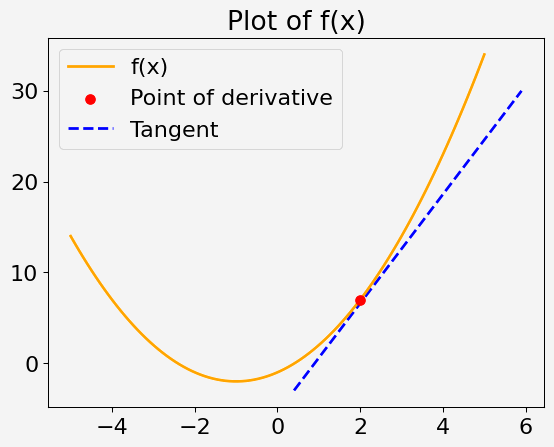

Beschouw een kwadratische functie van één variabele x, gedefinieerd als:

f(x) = x^2 + 2x - 1

Je taak is om de afgeleide van deze functie te berekenen bij x = 2.

Stappen

- Definieer de variabele

xop het punt waar je de afgeleide wilt berekenen. - Gebruik Gradient Tape om de berekening van de functie

f(x)vast te leggen. - Bereken de gradiënt van

f(x)op het opgegeven punt.

Opmerking

De gradiënt kan alleen worden berekend voor waarden van het floating-point type.

Oplossing

Bedankt voor je feedback!

single

Vraag AI

Vraag AI

Vraag wat u wilt of probeer een van de voorgestelde vragen om onze chat te starten.